Fysiikan tutkimuslaitoksen (HIP) historiaa

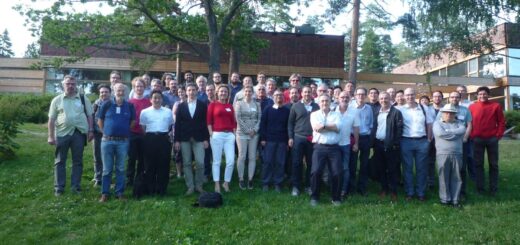

Fysiikan tutkimuslaitoksen toiminta alkoi syyskuun alussa vuonna 1996. Laitos ei syntynyt tyhjästä, vaan toiminta siirtyi uuteen laitokseen kolmesta erillisestä tutkimusyksiköstä: Helsingin yliopiston teoreettisen fysiikan tutkimuslaitoksesta (TFT) ja suurenergiafysiikan tutkimuslaitoksesta (SEFT) sekä Teknillisen korkeakoulun hiukkasteknologian...